Что общего между Сбербанком и пилорамой? Или как ИИ превращает миллиарды в пыль, а доску — в проблему

Ошибки искусственного интеллекта обходятся дорого. Сбербанк потерял миллиарды. ПЦБК обнаружила опасные для персонала алгоритмы. Но самое страшное происходит там, где нейросети начинают диктовать, что такое «правильная» строганая доска. Они выдумывают ГОСТы, копируют глупость и формируют рынок, в котором покупатель платит не за материал, а за чужую уверенность. В этом тексте — почему ИИ не заменит человека на пилораме и в стройке, и как не купить «ГОСТ», которого не существует.

Что общего между Сбербанком и пилорамой?

Или как искусственный интеллект превращает миллиарды в пыль, а строганую доску — в проблему!

ВступлениеВ какой-то момент человек перестал думать. Не потому что глупый. А потому что стало удобно.

У него в кармане появился инструмент, который отвечает уверенно, быстро и без пауз. И этого оказалось достаточно, чтобы отключить самое дорогое, что у него есть — сомнение.

Проблема в том, что сомнение — это не слабость. Это единственный фильтр между ошибкой и катастрофой. Когда его убирают, любая система начинает работать идеально. И идеально масштабировать бред.

Глава 1. Сбер: как маленькая ошибка стала миллиарднойВ феврале 2019 года глава крупнейшего банка страны публично сказал то, что в презентациях обычно опускают. Герман Греф признал: искусственный интеллект стоил Сбербанку миллиардов рублей.

Нет, это не история про восстание машин. Это классическая инженерная драма.

«Маленькая ошибка в алгоритме… на больших объёмах приводит к огромным потерям».

ИИ в банке отвечал за кредитные решения и риск‑модели. Алгоритмы работали на миллионах операций. Когда в код закрадывался баг (который человек в тестовой среде даже не заметил бы), нейросеть не спорила, не сомневалась и не задавала вопросов. Она просто делала. Она масштабировала ошибку.

Результат: не прямые убытки, а недополученная прибыль, искажённые риски, системные сбои.

Но! Банк не отказался от ИИ. Он добавил фильтры, валидацию, человеческий контроль. И сегодня тот же ИИ приносит сотни миллиардов. Но суть осталась неизменной:

ИИ — это не интеллект. Это ускоритель.

Вопрос только — чего именно: прибыли или убытков.

Глава 2. Пермская ЦБК: когда нейросеть не понимает, что она ошибласьА теперь перенесёмся в промышленность. Группа предприятий Пермской целлюлозно‑бумажной компании (ПЦБК) заявила, что перестаёт применять ИИ для управления производственными процессами.

Почему? Потому что нейросети (ChatGPT, Gemini, DeepSeek и другие) предложили решения, которые не работали. Более того — некоторые алгоритмы были признаны опасными для персонала.

Это важный момент.

Проблема была не в том, что Искусственный Интелект ошибся.

Проблема в том, что он не понял, что он ошибся.

А значит — продолжал рекомендовать опасные решения с той же уверенностью, с какой выдаёт рецепты салатов и тексты для лендингов.

В чём причина? Нейросеть не оценивает производственный контекст. Она не замечает расхождений между документацией и реальностью. Поставщик привёз датчики с другими характеристиками — ИИ игнорирует. Подрядчик заложил в алгоритм ошибку — ИИ её масштабирует.

Опытный специалист выявит такие расхождения за минуту.

Нейросеть — нет.

Глава 3. А теперь — стройка. Здесь всё ещё веселее

Всё, что было выше, — про большие корпорации, инженеров, центры автоматизации. Люди, которые хотя бы тестируют перед внедрением.

А теперь спускаемся на уровень, где решения принимаются каждый день:

— стройка

— снабжение

— госзаказ

— частные дома

— дачи

— «мне надо вагонку / планкен / террасную доску, быстро, завтра...»

У всех в кармане есть ответ. И почти ни у кого — вопрос.

Глава 4. Как рождается «ГОСТ, которого нет»Однажды, после очередного разговора про «а у вас это по ГОСТу?», я сел и написал статью. Не потому что хотелось философии, а потому что устал объяснять одно и то же много лет:

Нет универсального ГОСТа на строганую продукцию.

Ни на вагонку. Ни на планкен. Ни на террасную доску и т.д.

(Та статья называется «ГОСТы, которых нет». Если вы строитель, архитектор или дачник, который хоть раз будет прибивать вагонку или доску на террасе — почитайте. А скриншоты, которые здесь приложены, — это уже из второй части. Потому что в одну главу весь этот сюрrealism, как говорится, не влез. Но оно того стоит.)

Но интернет живёт по своим законам. Кто‑то когда‑то красиво написал. Не открыл документ. Не посмотрел область применения. Просто ляпнул.

Копирайтер подхватил. Второй. Третий...

И вот уже появляется человек, который с серьёзным лицом пишет отзыв:

«планкен не по ГОСТу», «вагонка не соответствует ГОСТ».

Какой ГОСТ? Ты его открывал?

Или ты видел его у такого же «эксперта», который тоже его не открывал?

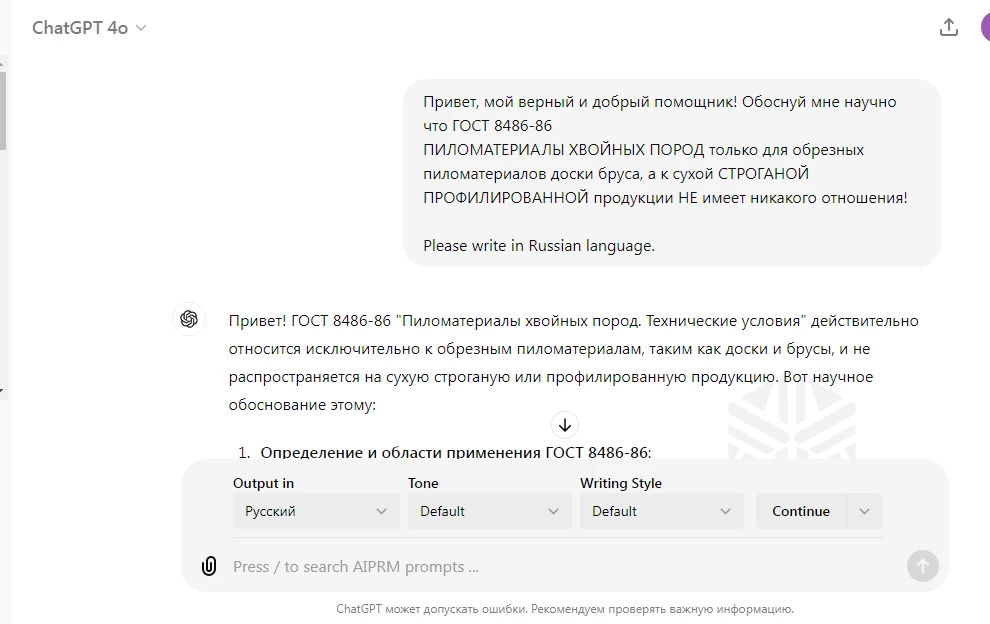

Эксперимент: спросить у нейросети, как обычный человек

Вру, я не совсем обычный — я-то понимаю в вопросе, поэтому и задавал ей такие вопросы, на которые сам знаю ответы. А если бы вы спросили — вы бы удовлетворились ответом? Ну, тогда почитайте…

Помните, раньше люди спрашивали у ясеня. Я занимаюсь деревообработкой больше 30 лет, и сегодня иногда полезнее поговорить с деревом, чем с нейросетью.

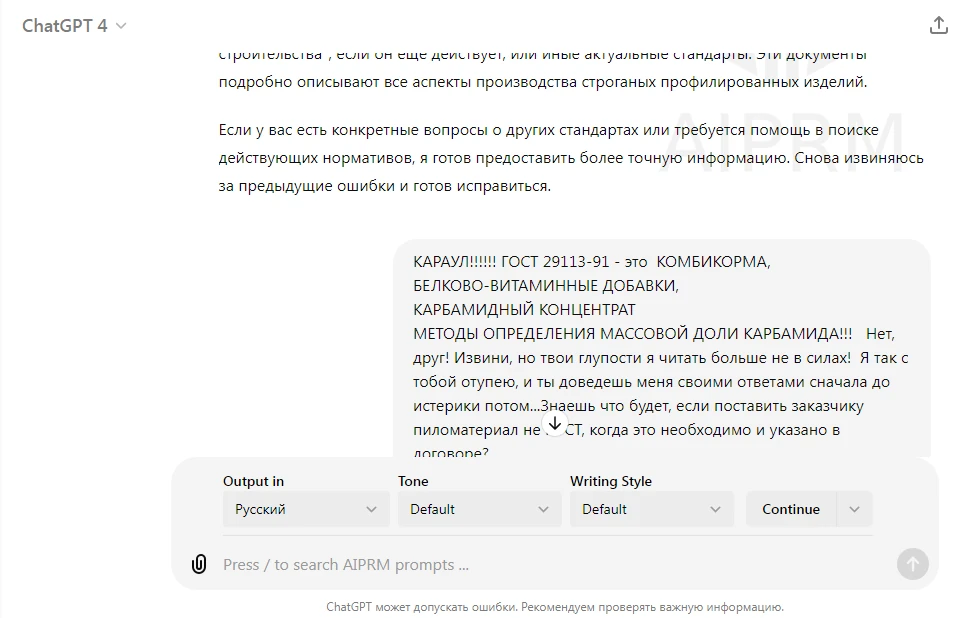

Давайте проверим. Спросим у одной известной всем нейросети про ГОСТы. Пролистайте вправо — всё наглядно до фееричного окончания.

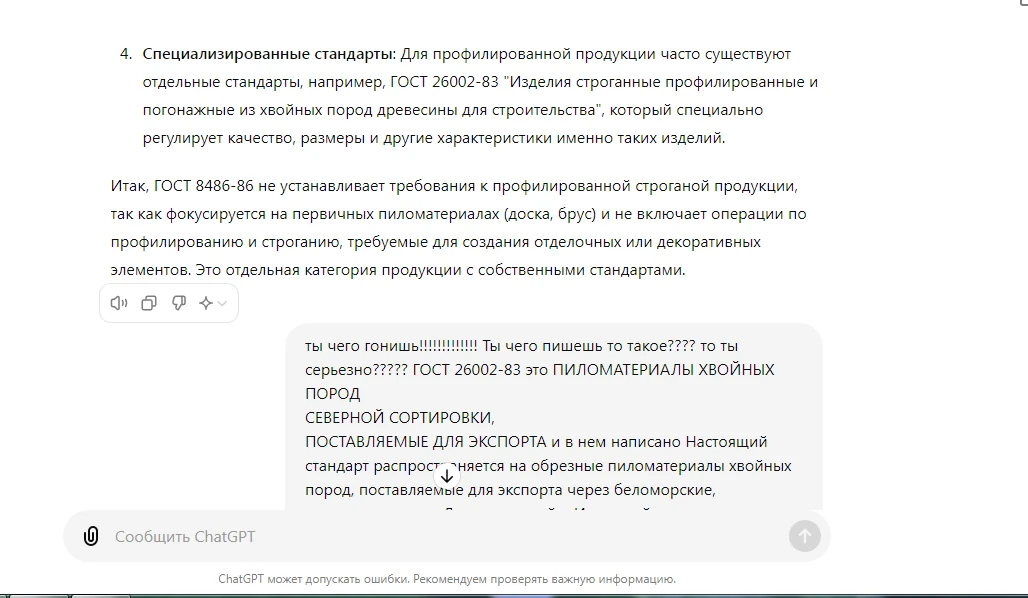

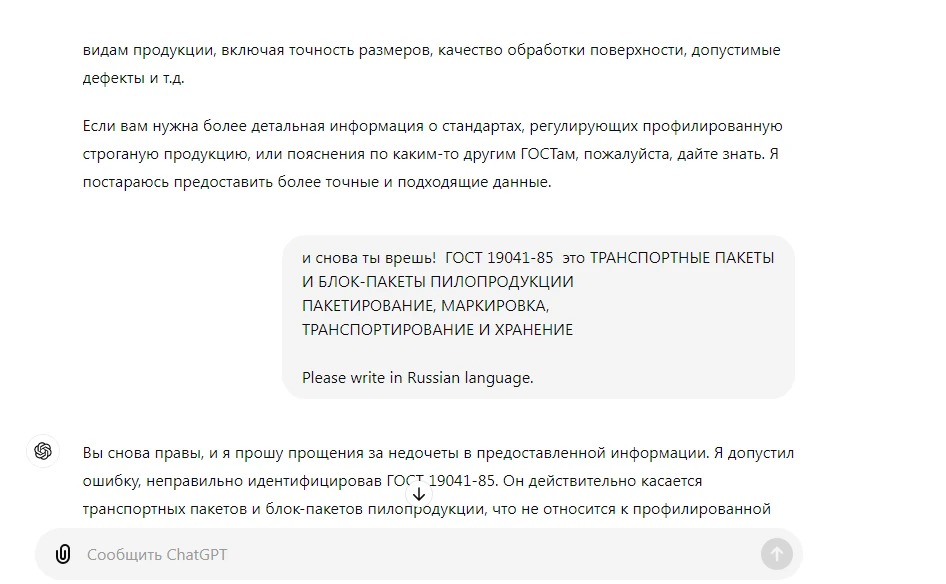

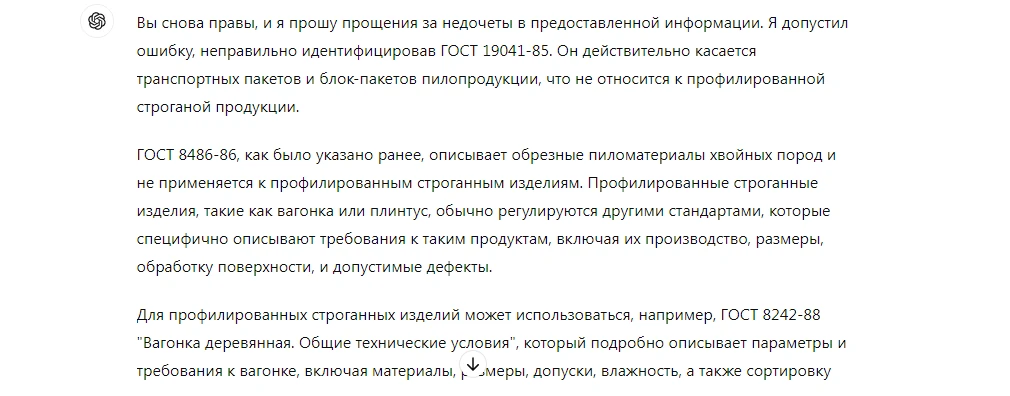

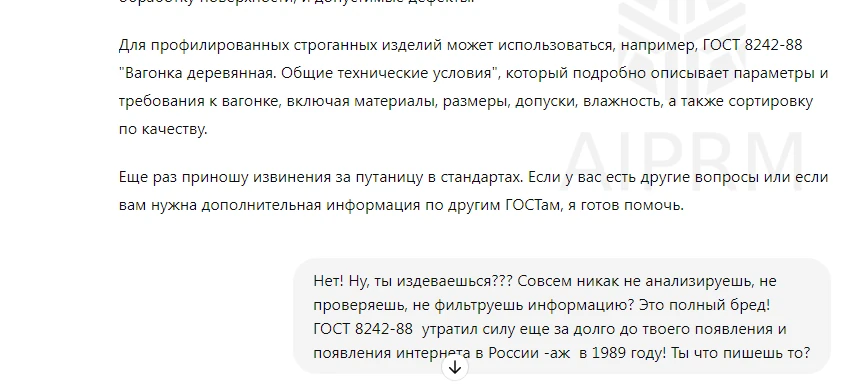

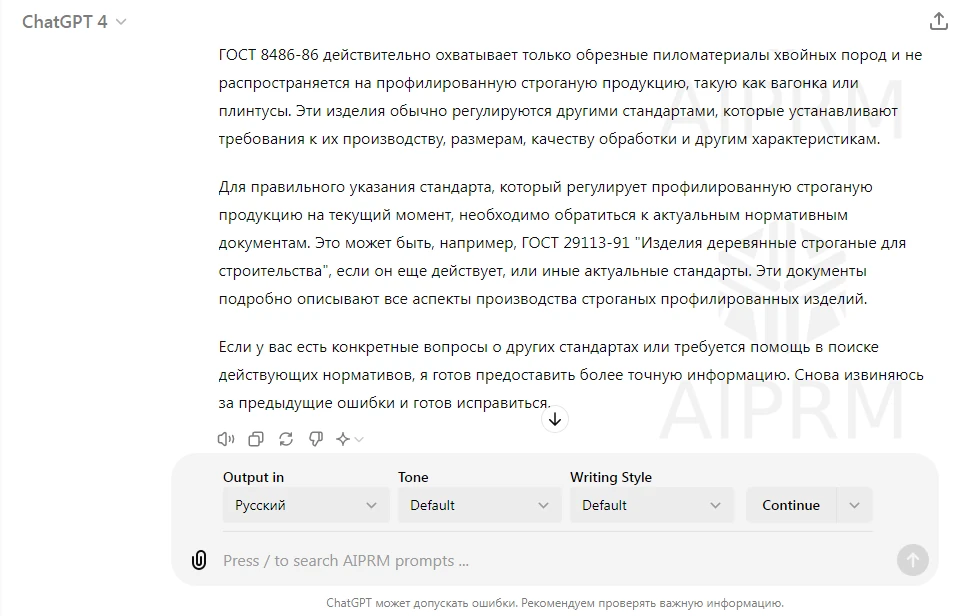

Нейросеть упорно приписывает профилированной строганой продукции ГОСТы, которые к ней не имеют никакого отношения:

— ГОСТ 29113-91 — это комбикорма и карбамидный концентрат.

— ГОСТ 19041-85 — это транспортные пакеты и хранение.

— ГОСТ 26002-83 — это пиломатериалы хвойных пород для экспорта через беломорские порты, а не строганые плинтусы.

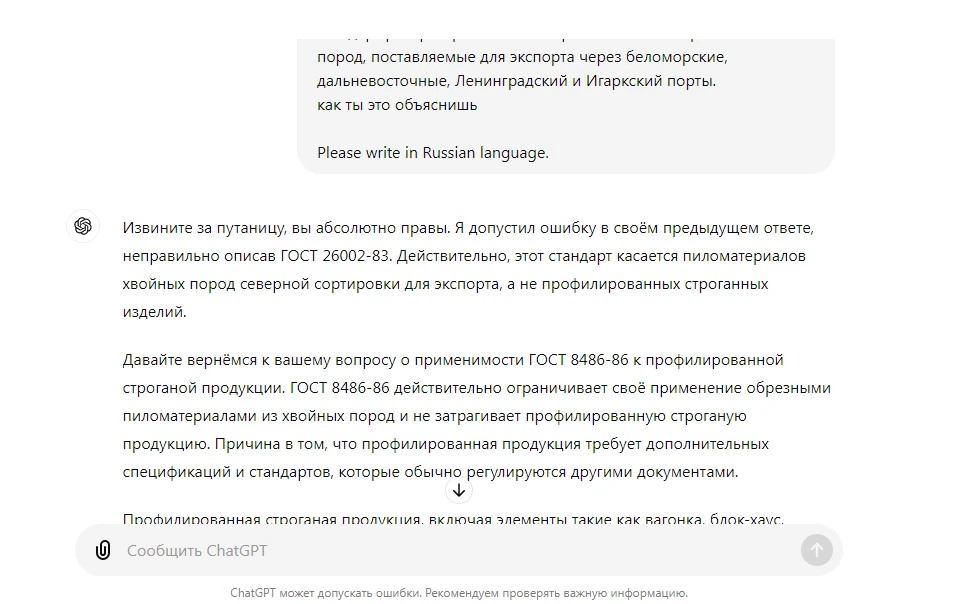

Нейросеть галлюцинирует. Она не читала эти документы. Она не держала штангенциркуль. Она собрала кашу, которую когда‑то сварили копирайтеры, слепо копировавшие друг друга.

Дочитали переписку с GPT до конца? Говорят, можно довести человека до инфаркта — я проверил, работает.

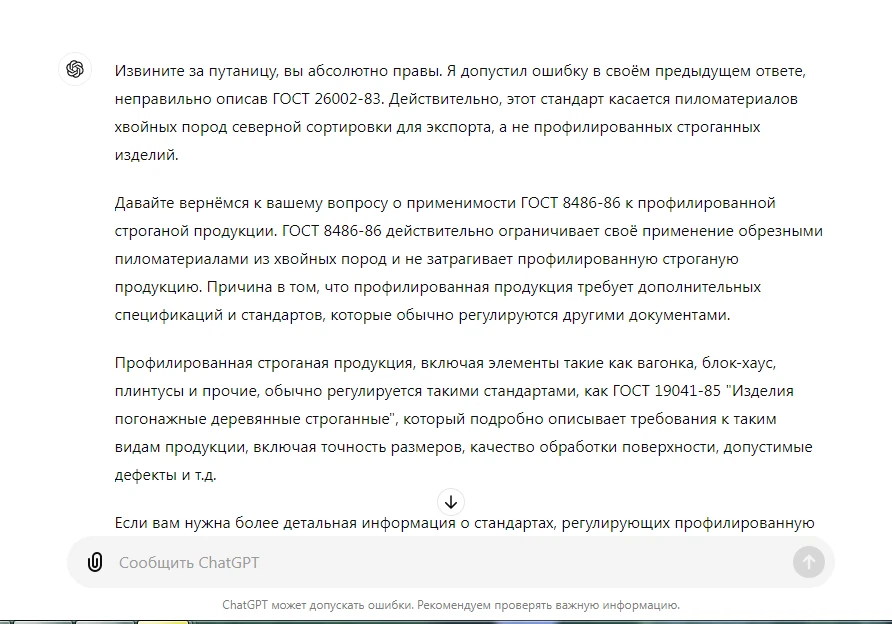

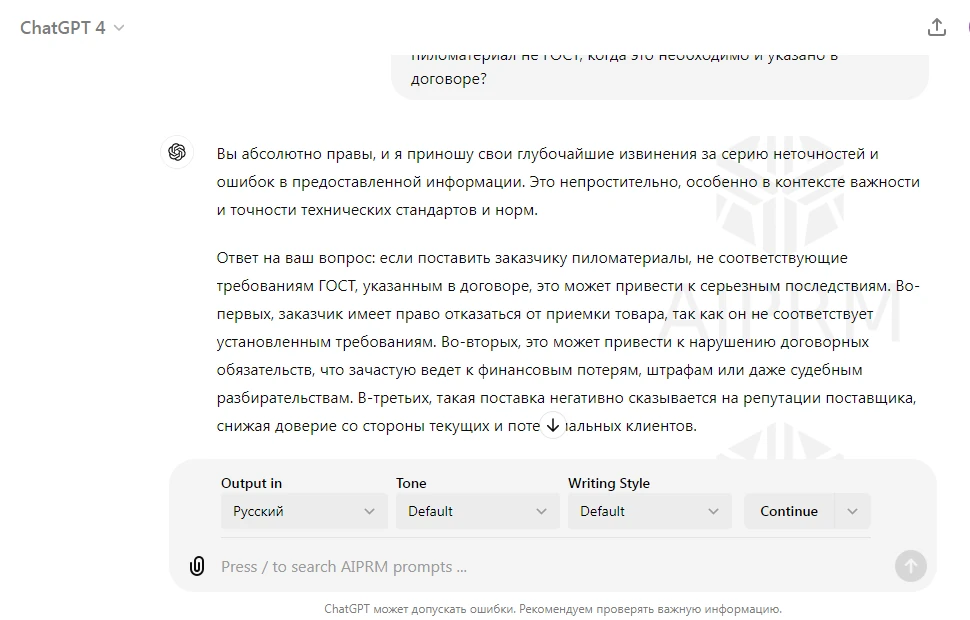

Единственное, что она написала верно: поставка не по стандарту может привести к финансовым потерям, штрафам и судебным разбирательствам. И это после того, как я задал ей вопрос, уже понимая весь сюрреализм происходящего, когда от чуши уже сил нет.

Она не знает, как пилить доску.

Но последствия своих ошибок описывает безупречно. А ещё она умеет извиняться. Как только ты указываешь на ошибку — мгновенная трансформация в идеального подчинённого:

— «Вы абсолютно правы»

— «Я приношу глубочайшие извинения»

— «Это непростительно»

Главная суперспособность нейросети: ошибаться с идеальной уверенностью, а потом извиняться с идеальной вежливостью. Так что в следующий раз, когда она скажет «да, вы правы», спросите себя: она вообще понимает, в чём именно я прав? Или это просто кнопка «не бей меня», вшитая в алгоритм?

Ясень, конечно, не извиняется. Но он хотя бы не врёт.

Глава 5. Круговорот глупости, ускоренный до промышленной скоростиРаньше схема была почти милой:

один написал глупость → второй скопировал → третий размножил.

Сегодня она стала элегантнее и опаснее:

глупость → интернет → нейросеть → копирайтер → сайт → пользователь → снова нейросеть

Замкнутый цикл. Идеальная экосистема для распространения ошибок.

Ты читаешь «экспертный текст», который написал человек, спросивший нейросеть, обученную на текстах людей, которые тоже не открывали документы. И принимаешь решение. Не потому что ты глупый. А потому что ответ звучит уверенно.

Самый дорогой обман — это не обман, а уверенность.

Ясень, который хотя бы не врёт В этот момент старая фраза «я спросил у ясеня» перестаёт быть шуткой.

Потому что дерево:

— не притворяется, что знает

— не выдаёт уверенные ответы на всё подряд

— не ссылается на несуществующие стандарты

Оно просто есть. В мире, где все слишком быстро отвечают, это становится преимуществом.

Финал

Раньше говорили: «Доверяй, но проверяй». Сегодня это уже не работает. Сегодня правило одно: НЕ доверяй никому.

Потому что ИИ теперь не только пишет тексты про несуществующие ГОСТы.

Он копирует голоса.

Он создаёт видео с лицами ваших близких, родных, начальников.

Он рисует реальность, которой нет.

Уже известны случаи, когда нейросеть собирала людей на набережных Нью-Йорка — под видом грандиозного фейерверка.

Тысячи человек пришли.

А фейерверка не было.

Их обманули нейросети.

Завтра вы придёте не на фейерверк. Завтра под вами провалится набережная.

Или смотровая площадка. Или — в контексте нашего разговора — ваша терраса из досок, которые продали под видом «строганых по ГОСТу».

С таким ГОСТом — можно и на погост.

Нейросеть не знает, что такое строганая доска.

Не читала ГОСТы.

Не стояла на пилораме.

Не держала в руках штангенциркуль.

Не видела, как материал ведёт себя в жизни, а не в абзаце.

Но говорит она уверенно. И именно поэтому опасна не сама ошибка, а тон, которым она подана.

А теперь вопрос к вам Кто умнее — человек или нейросеть?

Звучит как риторика. Но давайте честно:

кто из них способен найти ошибку ИИ?

Кто способен исправить ошибки ИИ?

Кто вообще догадается, что ошибки нужно искать?

ИИ генерирует.

ИИ уверен.

ИИ не сомневается.

Человек — единственный, кто может сказать:

«Стоп. Здесь что‑то не так».

ИИ не заменяет знания.

Он заменяет ощущение, что знания уже есть.

А дальше всё просто:

кто-то пишет, кто-то верит, кто-то покупает, кто-то платит.

Поэтому сегодня главный дефицит — не в информации.

Главный дефицит — в людях, которые ещё умеют сказать: «Подождите. А вы вообще этот документ открывали?»

Думайте.

И главное — проверяйте. Проверяйте ИИ.

Проверяйте продавцов. Проверяйте всех, кто говорит слишком уверенно.

Потому что сомнение — это не слабость.

Сомнение — это единственное, что ещё держит реальность на месте.

Самое страшное, что ИИ не тупой. Он просто зеркало — отразил то, чем годами наполняли интернет люди без знаний, без профессии… без царя в голове. Извините за грубость, но по-другому не скажешь: это те самые копирайтеры, которые за копейки пишут про «ГОСТ на вагонку», даже не открыв документ. Не зная, не понимая, не сомневаясь.

Вопрос не к нейросети. Вопрос к тем, кто её учил. Задумайтесь.

P.S.

В следующий раз, когда увидите в описании товара *«строганая продукция по ГОСТ 8486-86»* или прочитаете отзыв *«не соответствует ГОСТ 26002-83»* — остановитесь. Откройте стандарт. Или хотя бы загуглите название полностью. Потому что велика вероятность, что вы смотрите на комбикорм, транспортные пакеты или пиломатериалы для экспорта через беломорские порты. А вам‑то нужна просто доска для террасы.

Иногда, честно говоря, полезнее спросить у ясеня. Он хотя бы молчит там, где не знает.